12月31日上午,第50期由AIR DISCOVER实验室主办的AIR青年科学家论坛如期举行。本次活动我们有幸邀请到香港中文大学手术机器人、智慧医疗与安全具身智能领域的窦琪教授,分享其在医疗健康场景下具身智能 (Embodied Intelligence)方面的最新研究进展。

窦琪,现任香港中文大学计算机科学与工程学系副教授,港中文天石机器人研究所研究员,港中文智能医疗与扩展现实副所长,香港医疗机器人创新技术中心研究员,香港物流机器人研究中心副总监。研究方向包括智慧医疗,医学影像,智能手术机器人,具身操作等。窦琪教授的研究工作曾获多项国际和国内奖项,包括IEEE EMBS Early Career Achievement Award (2023)、教育部自然科学二等奖(2022)等。窦琪教授的论文曾获IJCARS-MICCAI Best Paper Awards (2021 & 2024)、IEEE ICRA Best Paper Award in Medical Robotics (2021)等奖项。

本次论坛窦琪教授主要讨论了医疗具身智能技术在应对人口老龄化挑战中的创新与应用。窦琪教授强调了医疗机器人技术在未来发展中的重要性。同时,窦琪教授介绍了其团队在手术机器人自主操作的研究进展,包括视觉感知、决策和执行能力等方面的挑战和解决方案。此外,窦琪教授还探讨了养老场景中具身智能发挥作用的技术模块和现有挑战。

随着我国人口老龄化问题日益凸显,社会对就医和养老的需求激增,传统服务模式面临挑战。具身智能技术的快速发展有望为医疗健康领域带来新的解决方案。通过赋予机器人智能感知、决策执行的能力,具身智能技术在各种医疗健康相关场景提供支持,包括但不限于手术机器人,康复机器人,医学检查,养老护理等智能化系统。医疗具身智能的实现不仅需要具备环境仿真、视觉感知、机器人学习、人机协作和机器人控制等通用具身智能场景的技术模块,还需要受限于医疗的特定场景,解决数据稀缺、高精度需求以及安全性等额外的挑战。基于此,窦琪教授介绍了其团队围绕具身智能创新技术,在手术和养老两个应用场景下的研究进展。第一,面向腔镜手术机器人自主操作,介绍团队全栈自研的具身智能模拟器 SurRoL,以及使用该模拟器实现的感知决策VPPV框架,完成可泛化的软组织自主操作,例如:组织牵引,血管夹闭。第二,面向养老场景的机器人物体安全操作,介绍团队基于大模型技术开发的一系列模块算法,包括物体位姿估计、灵巧手抓取、视触觉融合、以及基于视觉语言模型的长程任务规划,为养老场景提供安全具身解决方案。此外,窦琪教授还探讨了医疗具身领域当前面临的技术挑战与未来趋势,分享其在科研中的体会与思考。

窦琪教授指出,目前将微创手术从“机器人化”进一步推进至“智能化”,已具备现实可行性和迫切需求。窦琪教授系统介绍了手术机器人自主操作的发展阶段,并将其类比为自动驾驶的分级体系。目前行业整体仍处于以单一任务为核心的任务级自主 (Task Autonomy)阶段,未来有望向模块化自主 (Conditional Autonomy)迈进。该阶段的核心特征在于更高级的自主化手术操作能力,可在一定时间范围内稳定完成特定的长程任务,并作为外科医生的“智能副驾驶”,提升手术效率、质量、以及不同医生之间的操作一致性,而非取代医生本身。

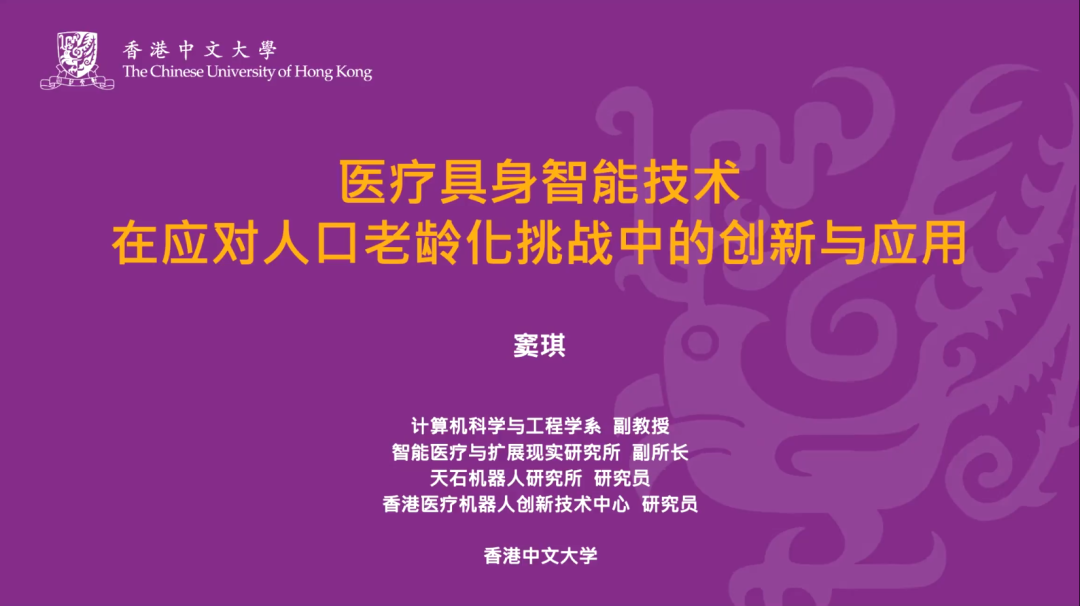

围绕这一目标,窦琪教授团队开展了一系列基于学习方法的手术机器人自主操作研究。然而,由于传统仿真平台无法支持手术机器人强化学习训练,该方向一度面临“无模拟器可用”的现实瓶颈。为此,团队决定自主研发面向手术机器人的具身智能仿真平台。经过多年持续投入,团队构建了全栈自研的手术学习平台。该平台从底层虚拟环境构建、物理仿真、运动学对齐到渲染与交互接口均实现自主开发。平台支持机器人运动学数据采集、复杂软组织交互建模以及多任务环境加载,为手术机器人自主操作算法提供了完整训练与验证基础。目前,该平台已全面开源,并被全球多家手术机器人研究机构采用,包括北美和欧洲的多所顶尖高校与研究团队。通过国际协作、开源社区建设以及医工深度融合,相关研究正持续推动手术机器人自主化从概念验证走向系统化发展。

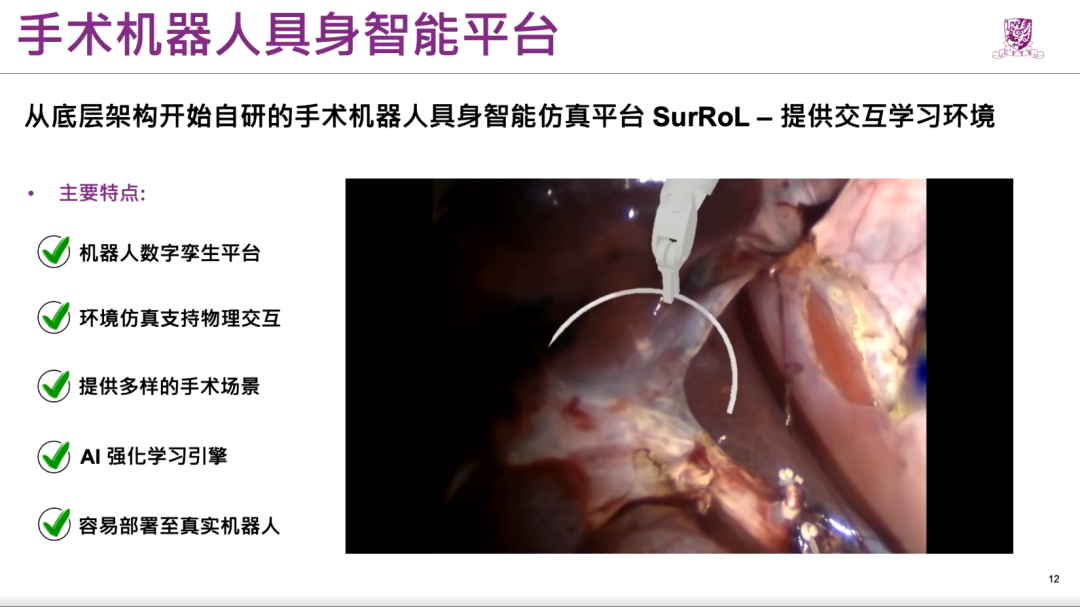

在算法层面,团队提出了混合式的VPPV感知—决策框架,为复杂手术场景提供了一种通用、可扩展的技术范式。该框架通过将不同手术任务拆解为可复用的操作步骤,在统一架构下完成数据训练与策略学习,避免了为每项任务单独设计系统的高成本问题。VPPV采用“学习+传统控制”相结合的混合式设计,在提升自主决策能力的同时,兼顾医疗场景对稳定性与安全性的要求。相比依赖多相机和高度定制化配置的方案,该框架更具通用性和临床可落地性,为手术机器人向智能协作方向发展提供了关键支撑。

在养老具身智能方向,窦琪教授指出,尽管该领域近来受到广泛关注,但目前仍缺乏清晰统一的技术定义和成熟范式。现有研究多集中于康复训练、情感陪伴、日常辅助与健康监测等子方向,在面临失能与半失能老人照护这一更具挑战性的真实养老场景中,机器人如何以“以人为中心”的方式安全、可靠地参与医疗与生活辅助,仍有大量关键问题有待解决。针对养老环境中物体种类多样、形态差异显著、人与机器人密集交互等特点,团队从底层能力建设入手,系统推进相关技术积累。

围绕这一目标,研究团队结合仿真环境构建与数据采集,探索面向家庭与养老机构场景的具身智能方法。基于NVIDIA平台,团队构建了一个高真实性的虚拟康养仿真平台,用于支持典型康养场景的三维建模以及老年人行为的精细化建模,并为基础场景理解与动作规划模型的训练提供仿真数据支持。

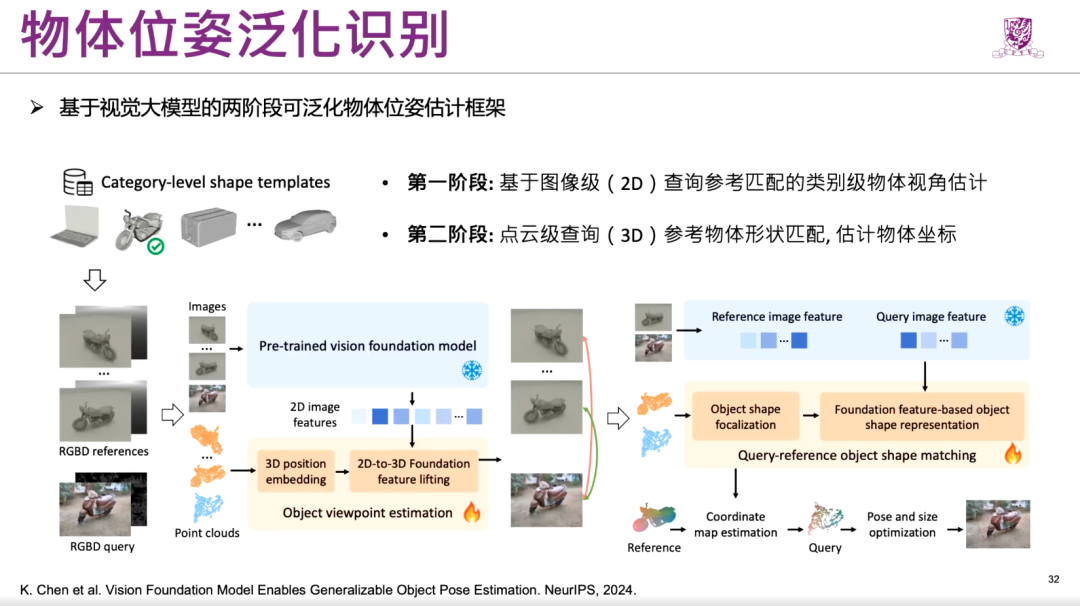

在感知层面,窦琪教授团队提出了基于视觉大模型的两阶段可泛化物体位姿估计框架,通过融合二维语义信息与三维几何特征,实现对未知物体的高泛化位姿估计,为后续操作提供可靠基础。此外,针对灵巧手的高复杂度构型,现有方法在未见物体上的抓取生成存在泛化性不足的问题,团队提出了基于生成式迁移的抓取框架,通过“模板采样-生成迁移”策略,将接触模式迁移至新物体,实现兼顾抓取质量、任务对齐、强泛化能力的灵巧操作。

本期AIR DISCOVER青年科学家论坛系统展示了具身智能技术在手术与养老两大医疗健康核心场景中的发展潜力与现实挑战。从腔镜手术机器人迈向智能化、自主化协作,到面向失能与半失能老人的安全养老辅助探索,相关研究体现了以临床需求和真实应用场景为导向的技术路径。窦琪教授表示,医疗具身智能的发展既需要底层技术的持续突破,也离不开医工融合、开源协作与跨学科交流的共同推动。随着人口老龄化进程加速,具身智能有望在未来医疗与养老体系中发挥越来越重要的支撑作用。