神经科学能够为AI提供启示作用,AI迈向真正智能的道路也需要神经科学的检验。

——高剑峰

7月6日上午,第24期AIR学术沙龙如期举行。本期活动荣幸地邀请到了微软副总裁高剑峰为我们做题为《Brain-inspired Efficient AI modeling》的报告。

本次活动由清华大学讲席教授、智能产业研究院(AIR)院长张亚勤院士主持,AIR官方视频号和b站同步直播,当日线上逾3500次观看。

Jianfeng Gao is a Distinguished Scientist and Vice President of Microsoft. He is the head of the Deep Learning group at Microsoft Research, leading the development of AI systems for natural language processing, Web search, vision language understanding, dialogue, and business applications. He is an affiliate professor of Computer Science & Engineering at University of Washington, an IEEE fellow, and a Distinguished Member of ACM.

过去的十年,AI的发展十分迅速,不断出现在具体任务上表现甚至超越人类的大型的神经网络模型。一般来说,这些模型的惊人表现很大程度上归结于大数据,以及强大的算力。这些基于深度学习的模型,是否真正具有深度的理解能力呢?相比人类,目前的深度学习模型缺失了什么?神经科学(Neuroscience)可以为回答上述问题提供重要启示。事实上,早期的神经网络的设计便受到人脑运作机理的一些启示(如神经元的设计、神经元之间的交互等)。神经科学不仅能够为AI提供技术上的启示,也能够作为目前的AI技术验证提供重要的参考依据。

脑启发的高效深度学习

(Brain-inspired Efficient Deep Learning)

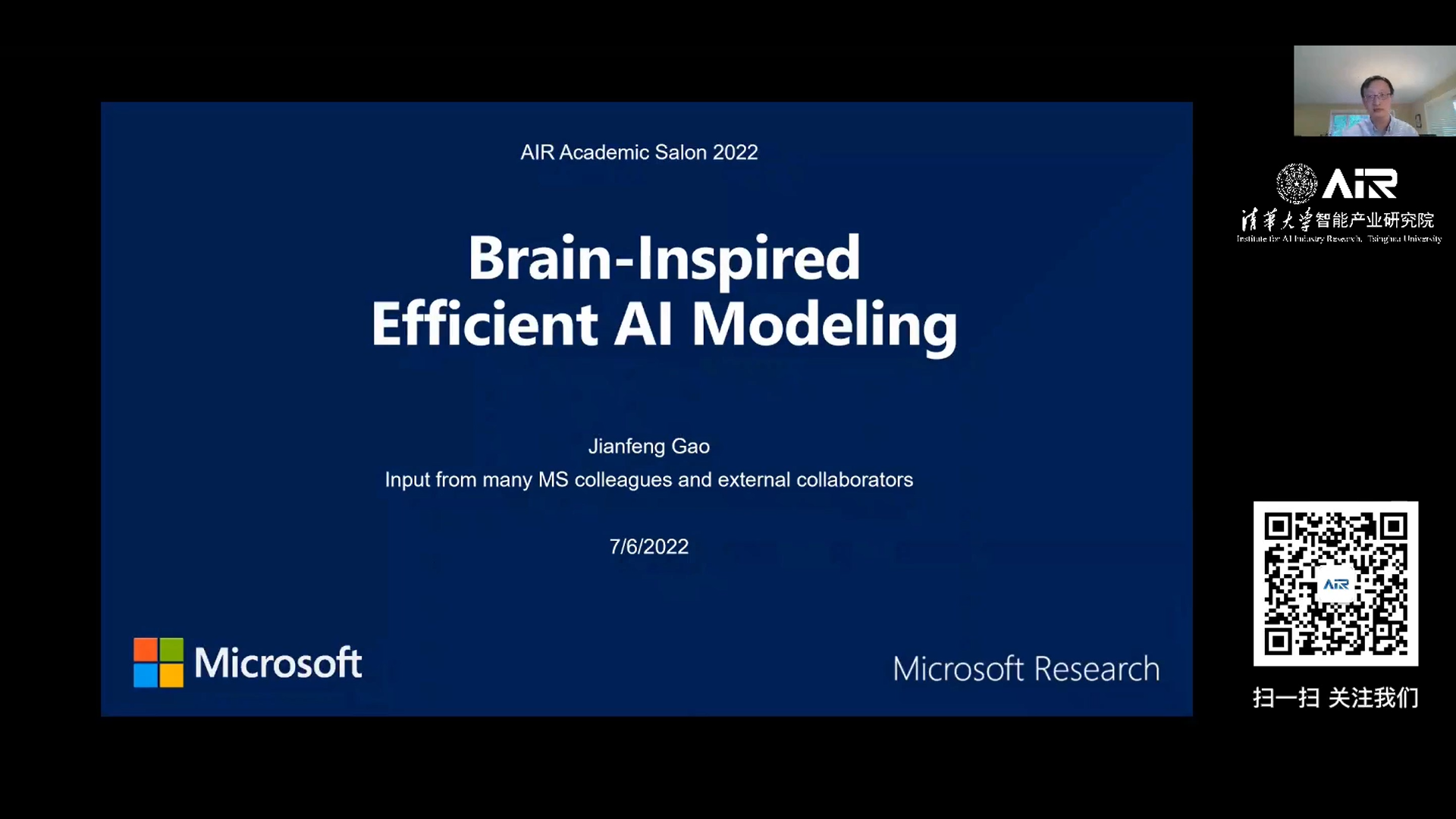

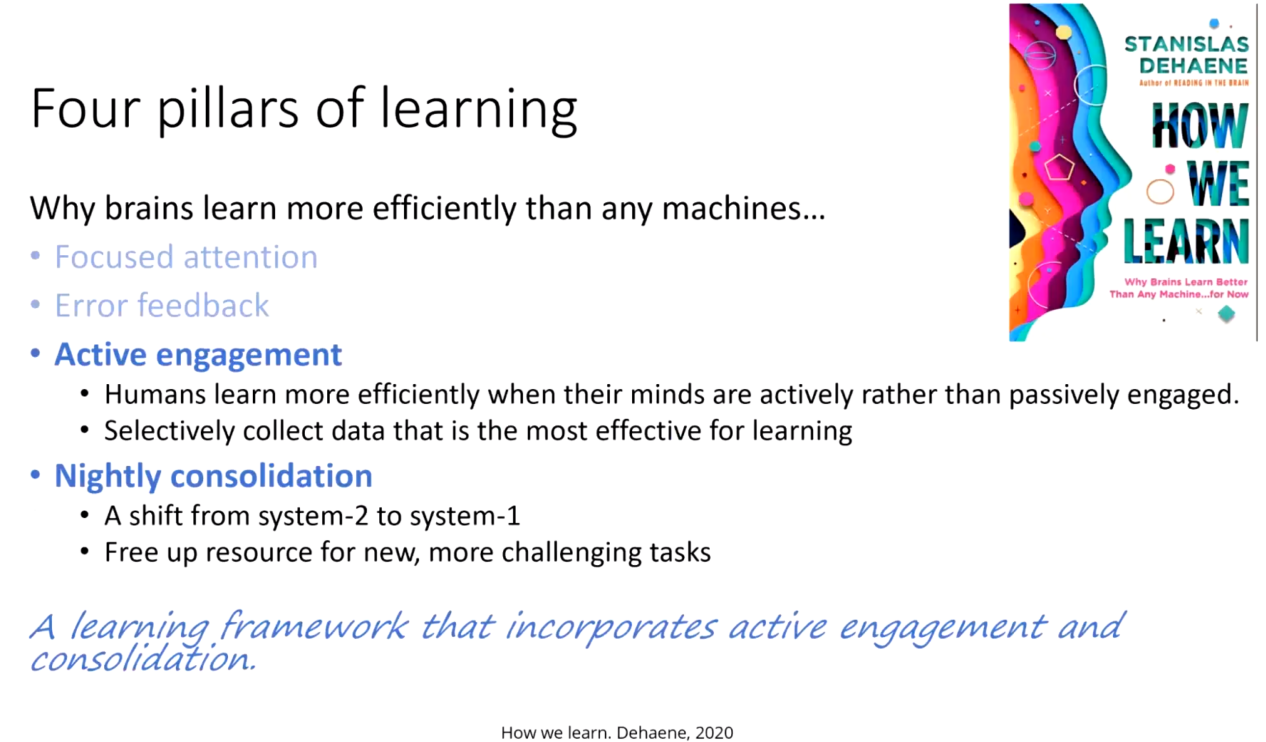

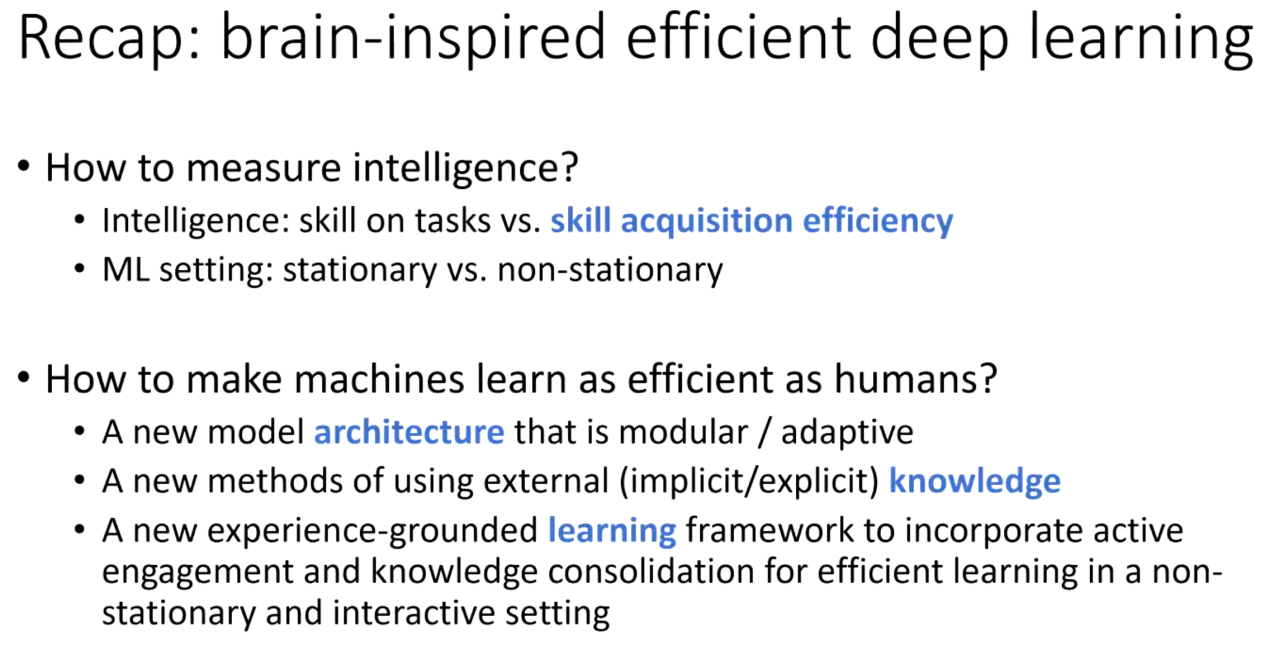

报告引用出自于Dehaene所著《How We Learn》一书中的一幅插画展示了人脑在学习过程中的一些特点:首先,人脑具有模块化的结构(Architecture),不同模块之间会产生交互;第二,人脑具有很强的先验知识(Knowledge),这些先验知识在人脑早期就已经形成,并能够帮助后续知识的高效学习,这一点上与贝叶斯学习近似;第三,人脑对环境能够适应,交互性地学习(Learning),能够从以往的学习过程中汲取经验。人脑在结构、知识、学习三方面的特点均可以启发我们的研究,从而让机器更加像人类地去学习,去迈向真正的智能,也即脑启发的高效深度学习(brain-inspired efficient deep learning)。

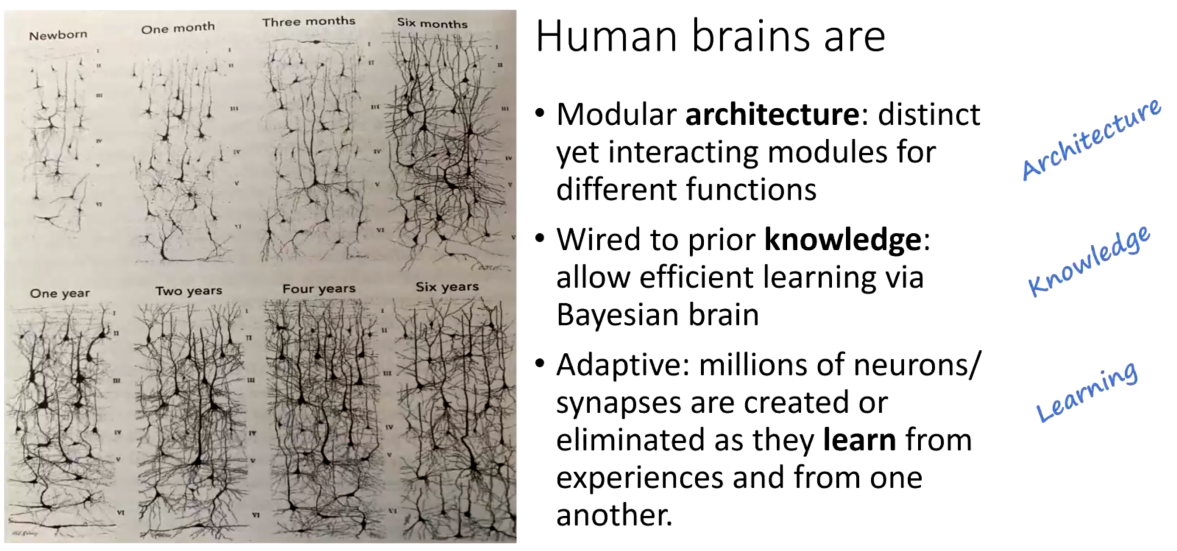

相比于人的学习过程,目前在同分布数据上训练得到的模型在真实世界应用中并不鲁棒,主要表现为两个突出问题:一是灾难性遗忘(catastrophic forgetting),即在学习新的任务的时候,旧任务学习到的知识逐渐衰退;二是适应效率低(slow adaptation),主要成因包括缺乏针对新任务的大量数据,以及为了保持已学到的知识所增加的过强的模型约束。

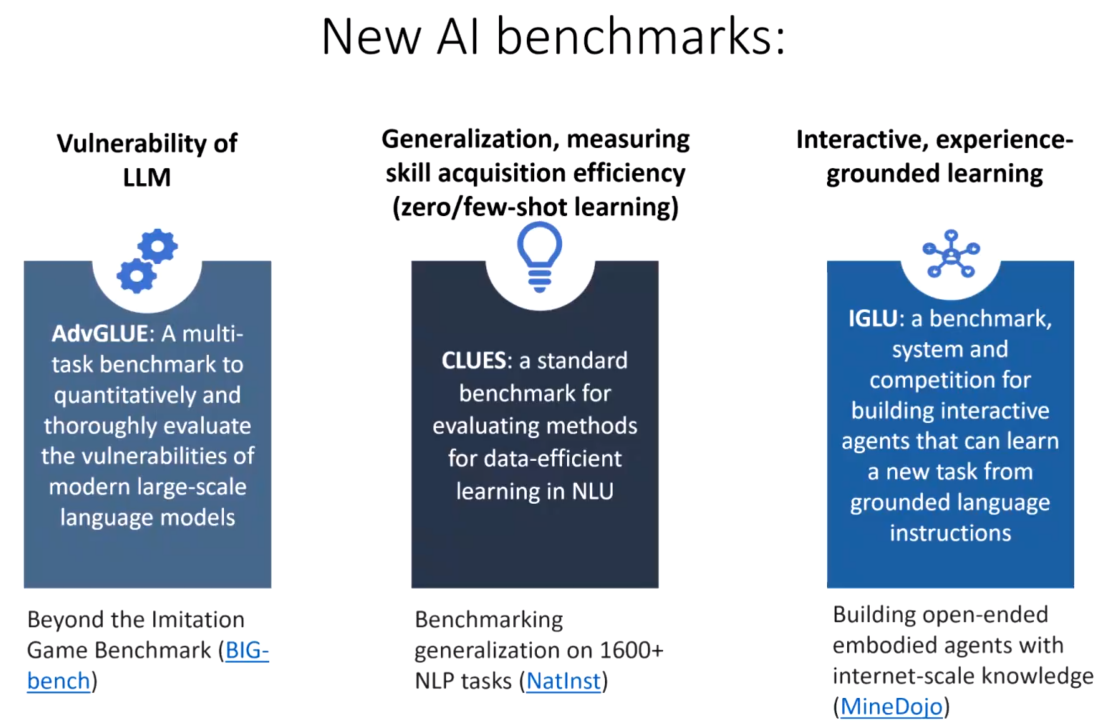

理想的AI模型应该具备一些重要的特征,一方面模型的学习过程应当是动态的、能够适应环境变化,而非静态的、任务特定的;另一方面,模型应该具备高效掌握多种技能的能力,而非仅具有处理特定任务的特定技能。当前学术界也推出了一系列非特定任务导向的AI模型评估基准测试集[1][2][3]。

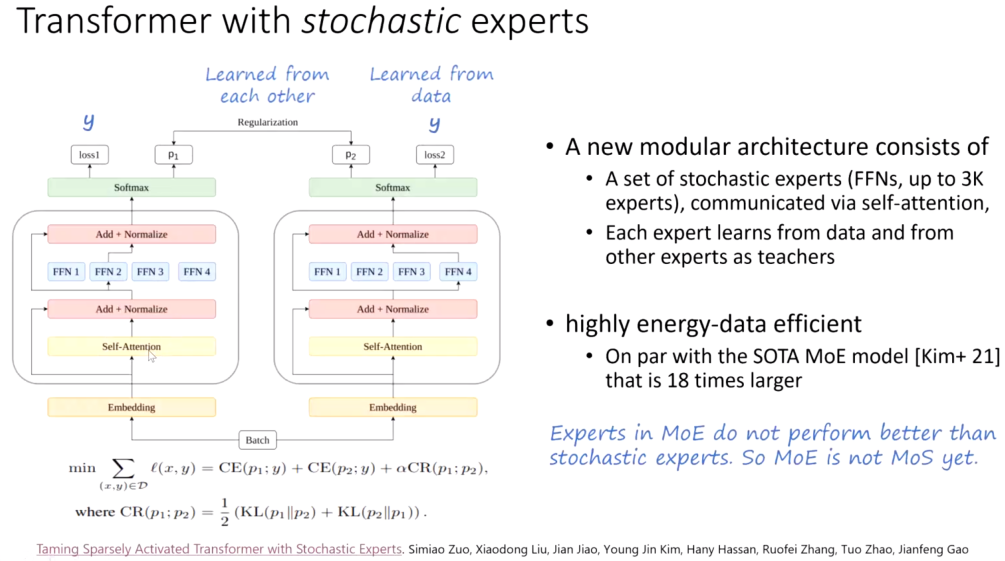

在模型架构上,高教授团队提出了Transformer with Stochastic Experts [4]。该工作参考了专家网络(Mixture of Experts,MoE)的思路,为Transformer模型设计了不同的前馈网络(Feed Forward Network)子结构作为随机专家(stochastic experts),它们之间通过自注意力机制进行交互。每个专家可以从数据中学习,也可以从其它专家上进行学习。该方法能够在参数更少的情况下与最先进的专家网络方法取得可比的结果。

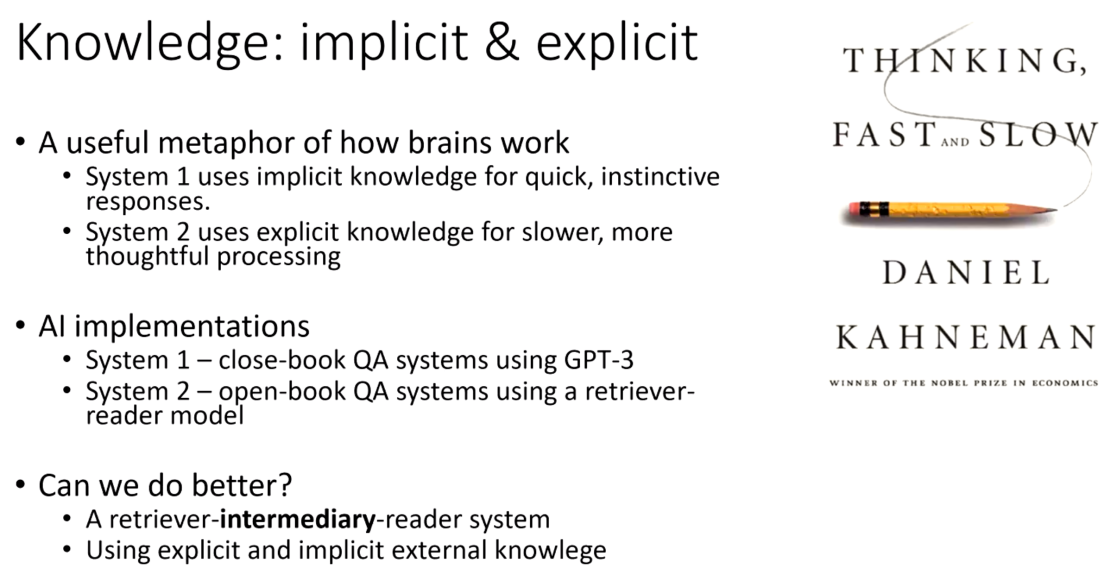

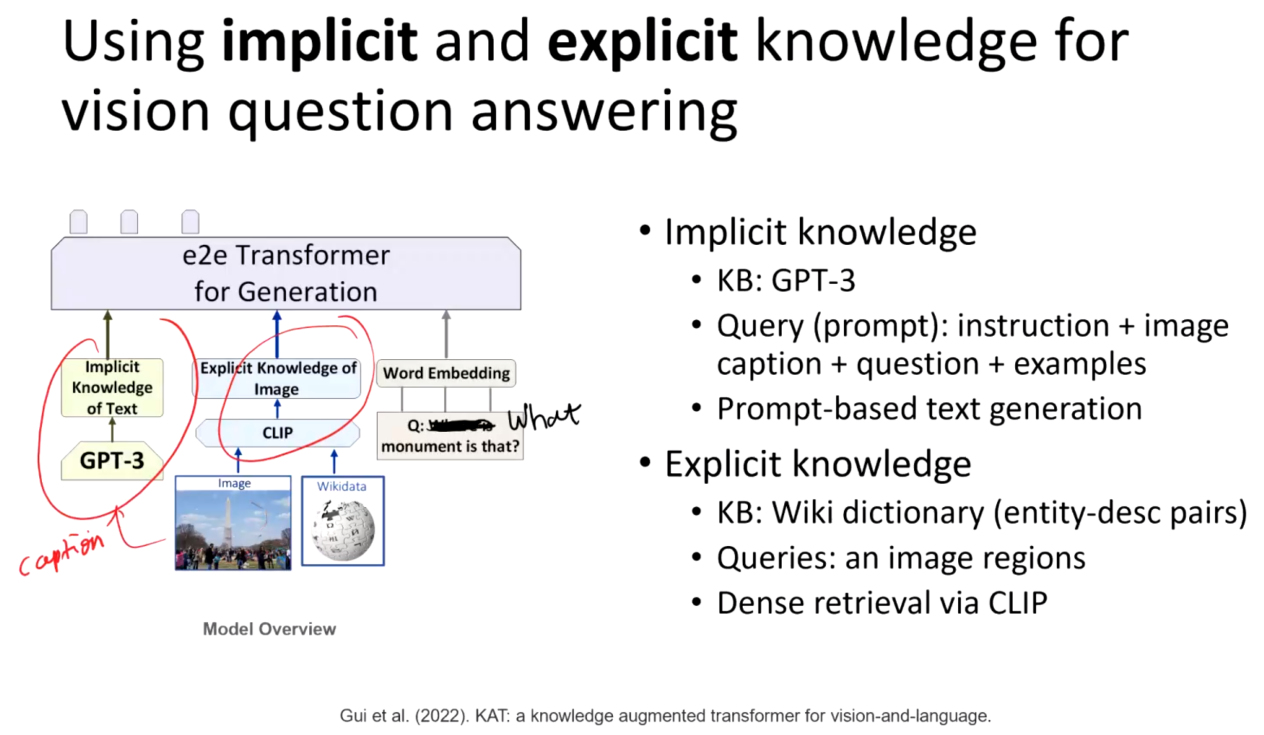

在Daniel Kahneman所著的《Thinking, Fast and Slow》一书中,认为人脑具有两种运行机制系统一(System 1)和系统二(System 2)。系统一利用隐式知识(implicit knowledge)完成快速的、基于直觉的动作;系统二利用显式知识(explicit knowledge)完成慢速的、更具思考的过程。GPT-3模型在闭卷问答(close-book QA)场景下,不需要额外的知识或者参考,便可以完成特定的任务,可类比于系统一;而使用检索-阅读模式模型(retriever-reader model)解决开卷问答(open-book QA)场景问题时,则需要参考或检索特性知识来帮助解决当前问题,可类比于系统二。受这两种思路的启发,高教授提出可以将原有的“检索-阅读(retrieve-reader)”模式扩展为“检索-中介-阅读(retrieve-intermediary-reader)”模式,其中中介(intermediary)用于进行知识的梳理;同时也需要结合隐式和显式的外部知识。

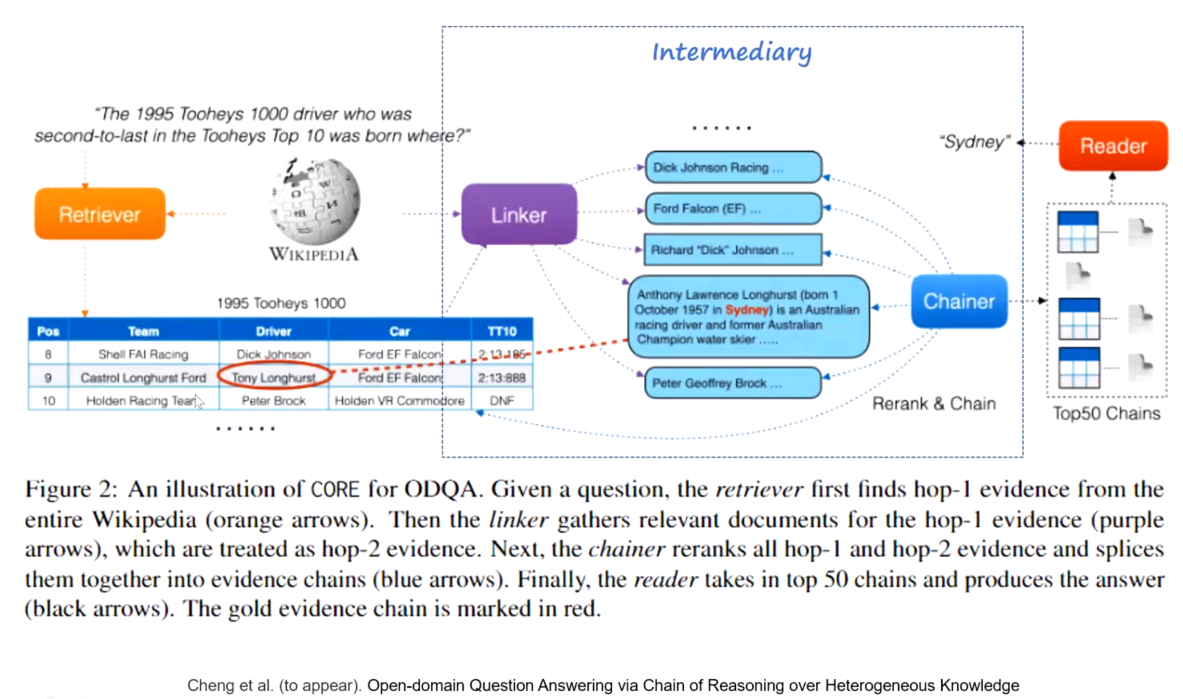

报告介绍了“检索-中介-阅读”模式的一个应用例子,该例子基于推理链(Chain of Reasoning)完成开放问答,在传统的检索-回答过程中加入了多层级的检索、整理过程,来帮助模型进行更好更完整的理解问题,检索答案并回答问题的能力。

同时报告也介绍了一个结合隐式和显示外部知识的代表性工作[5],该工作综合融入不同内部知识(知识图谱、图像标注、语言提示等)及外部知识(维基词典、基于CLIP模型的检索结果等)来完成视觉问答任务。

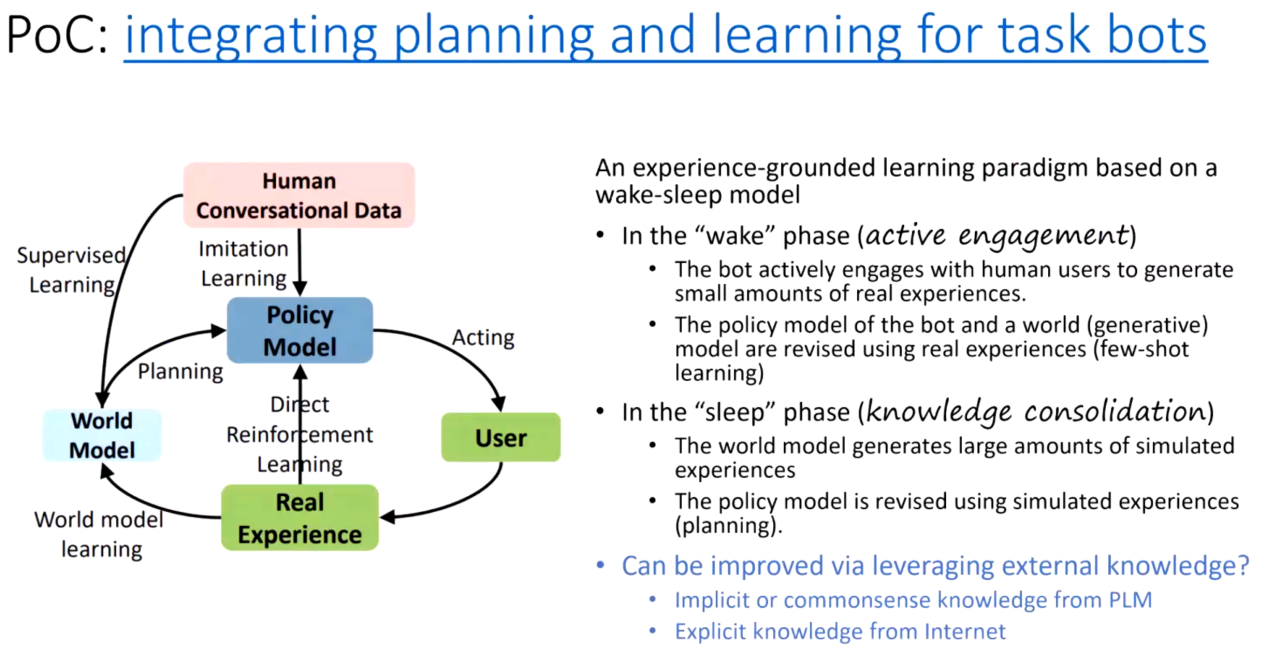

《How We Learn》一书中对人脑运作方式进行了一些总结。人脑除了能够对事物存在较强的注意力以及错误反馈之外,active engagement和nightly consolidation两个机制尤其值得关注,即人具有主动参与学习以及温故知新、举一反三的能力。

报告中介绍了一种仍处于研究阶段的结合activate engagement和nightly consolidation两种机制的学习框架。在activate engagement阶段,机器人(bot)能够与人交互,从少量的经验中进行学习;在nightly consolidation阶段,世界模型(world model)会产生大量的模拟的经验,策略模型(policy model)基于这些模拟的经验进行修正。

报告也讨论了构建collaborative AI agent的一些思路,如能够有计划从真实世界获取可用的知识,并能够适应不同的环境做出不同的反馈等。目标在该方向也有一系列优秀的工作,如Collaborative Dialogue in Minecraft[6],MineDojo: Building Open-Ended Embodied Agents with Internet-Scale Knowledge[7]等。

本报告从神经科学出发,围绕结构、知识、学习三个维度系统讨论了如何使AI像人一样学习。经过多年的发展,已有AI模型取得了很大的进步,然而未来的AI模型还有很大的发展空间,将在迈向真正智能的道路上不断前进。

[1]Wang et al., Adversarial GLUE: A Multi-Task Benchmark for Robustness Evaluation of Language Models. NeurIPS 2021.

[2]S. Mukherjee et al., CLUES: Few-Shot Learning Evaluation in Natural Language Understanding. NeurIPS 2021.

[3]Kiseleva et al., IGLU 2022: Interactive Grounded Language Understanding in a Collaborative Environment at NeurIPS 2022. Arxiv 2022.5

[4]Zuo et al., Taming Sparsely Activated Transformer with Stochastic Experts. ICLR 2022.

[5]Gui et al., KAT: A Knowledge Augmented Transformer for Vision-and-Language. NAACL 2022.

[6]Narayan-Chen et al., Collaborative Dialogue in Minecraft. ACL 2019.

[7]Fan et al., MineDojo: Building Open-Ended Embodied Agents with Internet-Scale Knowledge. Arxiv 2022.6

文稿撰写 / 王祎乐

排版编辑 / 张子瞻

校对责编 / 黄 妍